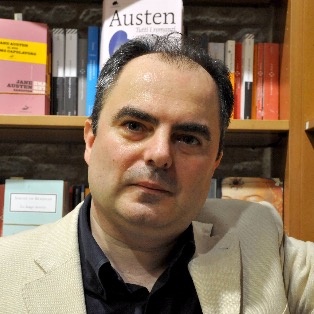

“È più semplice attaccare il cervello delle persone, per entrare nel loro computer o telefono, che il device informatico stesso”: è così che Giovanni Ziccardi – Professore di Informatica Giuridica all’Università di Milano, nonché Founder e Direttore del corso post-graduate in Legal Informatics, Computer Crimes e investigazione digitale nella stessa Facoltà – illustra uno degli annosi problemi che emerge quando si parla di tutela dei dati degli utenti web.

Il sistema in cui le persone navigano, entrano in contatto e immettono informazioni, un sistema che proprio ai dati degli utenti dà sempre più peso e valore, spesso non solo non agevola e rende difficoltoso tenere comportamenti più prudenti e virtuosi online, ma costringe molti utenti ad agire mettendo a repentaglio la propria sicurezza e privacy: ciò avviene ignorando Termini e condizioni delle piattaforme che utilizziamo, non attivando l’autenticazione a due fattori o cliccando su link di phishing, truffa informatica, ricevuti via mail o sms.

Come già discusso su questo blog, il contesto in cui le persone operano è spesso determinante nel veicolare azioni più o meno corrette e benefiche per l’individuo che, come unica “arma” per tutelare sé stesso e le proprie informazioni, ha la consapevolezza di dover agire in modo più cauto e tutelante, attivandosi in prima persona con piccoli ma doverosi interventi preventivi.

Ne abbiamo parlato con il Professor Giovanni Ziccardi e con l’Avvocato Guido Scorza, componente del Collegio del Garante per la protezione dei dati personali, già avvocato cassazionista e socio fondatore dello Studio Legale E-Lex, per analizzare come la “human security” possa essere un primo step per proteggere i nostri dati digitali in attesa che piattaforme, istituzioni e il sistema si adoperino per farlo in modo migliore rispetto ad oggi.

Sono passati tre anni da quando la GDPR, il regolamento generale sulla protezione dei dati è diventato operativo nell’Unione Europea.

- Cosa è cambiato da allora? L’utente è davvero più tutelato rispetto a prima della GDPR?

Ziccardi: Questi ultimi anni, per la protezione dei dati, sono stati molto complessi. Innanzitutto, il GDPR ha cercato di dare continuità a un quadro di protezione che esisteva dal 1995 (con la “Direttiva Madre”) ma che era diventato frammentato e poco omogeneo nei singoli Stati: non si presentava per cui come una norma radicalmente nuova ma assorbiva molti principi già consolidati nel tempo (ad esempio il principio di trasparenza, o la centralità dei diritti dell’interessato). Dall’altro, l’uso del Regolamento voleva chiaramente riportare coerenza in tutti i Paesi vista anche la nuova società digitale che ha abbattuto confini e che vede la circolazione del dato ormai senza limiti.

Poi vi è stata la pandemia, che è arrivata proprio in un momento in cui la “macchina”, in Italia, stava partendo dopo un paio d’anni di ritardo dovuti allo stallo politico che aveva ritardato la nomina del nuovo Collegio del Garante. Siamo, quindi, andati a regime un po’ più tardi di altri Paesi, ma l’attività ispettiva è partita e le risposte del Garante ai cittadini si sono fatte via via più numerose, sino a garantire un quadro di protezione solido. Le tutele, quindi, ci sono.

Il problema, nella pratica, può essere l’applicabilità di queste tutele nei confronti dei grandi operatori e provider, che spesso sono “impermeabili” anche alle istanze di Governi e Autorità. Il Garante italiano, ad esempio, ha adottato provvedimenti nei confronti dei “grandi”, ad esempio TikTok, o Facebook, cercando proprio di garantire una tutela concreta anche del “piccolo utente” nei confronti di queste aziende che, ormai, hanno una potenza economica maggiore di tanti Stati.

Scorza: Sono, probabilmente, ottimista ma credo che il livello di protezione di oggi sia superiore rispetto a quello di ieri almeno perché ciascuno di noi – anche se non addetto ai lavori – oggi, anche grazie al GDPR, ha una maggiore consapevolezza in materia di privacy e suoi strumenti di tutela. Ovviamente la strada è ancora lunga ma, credo che anche a prescindere da qualsiasi valutazione di ordine tecnico-giuridico, al varo del GDPR vada riconosciuto almeno il merito di aver contribuito alla diffusione di una cultura di base della protezione dei dati personali.

Anche a guardare al GDPR in termini tecnici, peraltro, occorre riconoscere che ha rappresentato un giro di boa significativo in termini di rafforzamento della tutela specie nell’ecosistema digitale e, in generale, in quello delle nuove tecnologie.

Oggi abbiamo norme più uniformi in tutta Europa il che, peraltro, semplifica la libera circolazione dei dati personali, gli utenti dei servizi online possono garantire di uno stesso livello di tutela a prescindere dal Paese di stabilimento del fornitore del servizio nel cui ambito sono trattati i dati personali, le nuove sanzioni hanno reso il rispetto della privacy un fatto più significativo per i titolari del trattamento pubblici e privati perché rischiare una sanzione stellare preoccupa di più che rischiarne una facile da assorbire nel proprio modello di business o nella propria attività pubblica e, da ultimo, al GDPR va riconosciuto anche il merito di rappresentare, anche se ancora solo in una dimensione embrionale, un esercizio di governo del rapporto tra uomini, algoritmi, robot e intelligenze artificiali.

- In una società in cui il dato ha e avrà sempre più rilevanza e peso, come possono istituzioni e aziende essere più trasparenti con i consumatori rispetto alla tutela dei loro dati?

Ziccardi: Molte aziende hanno avviato da tempo una corsa alla raccolta dei dati, basandosi sull’asserzione, che sentiamo spesso ribadire, che “il dato sia il nuovo petrolio”, ma non garantiscono la stessa cura e zelo alla protezione di quei dati che raccolgono. Un primo modo per essere trasparenti nei confronti dei consumatori potrebbe essere, allora, una maggior responsabilizzazione nell’allestire misure di sicurezza che siano realmente efficaci in un quadro che gli esperti percepiscono come molto fragile e vulnerabile.

Data breach quotidiani, informazioni date agli utenti in ritardo, o tenute nascoste, su “accidenti” occorsi ai loro dati, informative complesse e poco trasparenti, raccolta del consenso non chiara, mancanza di referenti specifici con cui dialogare per problemi di sicurezza e privacy sono tutti fattori che contribuiscono, in molti casi, a creare un quadro problematico. Non bisogna mai dimenticare che al centro di tutto il sistema c’è il dato dell’interessato, ossia le informazioni delle persone, che devono essere il primo elemento da tutelare.

Scorza: Se si perde la partita della trasparenza effettiva il resto della disciplina sulla protezione dei dati personali e, in prospettiva, anche quella in materia di intelligenza artificiale perdono gran parte del loro significato. Oggi, a voler essere onesti, occorre riconoscere che la disciplina attuale – inclusa quella del GDPR – sotto tale profilo, è lontana dal poter essere considerata efficace.

Purtroppo gli obblighi di informazione, nella loro attuale formulazione, sembrano aver fatto il loro tempo: i fornitori di servizi adempiono con “lenzuolate” di informazioni praticamente illeggibili e gli utenti aderiscono ai contratti e prestano consensi al trattamento senza leggere nulla.

È indispensabile investire in maniera crescente nel legal design per rendere sempre più intuitive e accessibili le interfacce e i contenuti che veicolano le informazioni sulla privacy, combattere in maniera sempre più determinante i black pattern e educare gli utenti e i consumatori alla cultura dei dati personali e della loro protezione perché solo così si potrà, un giorno, sperare che il livello di protezione dei dati personali garantito da un brand rappresenti almeno uno dei fattori che spinge il consumatore alla scelta di un prodotto o di un servizio un po’ come oggi accade nel settore automobilistico per i parametri relativi all’inquinamento ambientale. Una volta che accadrà saranno gli stessi titolari del trattamento a far sempre di più per essere trasparenti per davvero nei confronti degli utenti per essere preferiti dai consumatori.

- La pandemia da COVID-19 ha chiesto un maggior tracciamento dei dati degli utenti (pensiamo all’app Immuni) per contenere e identificare potenziali contagi: qual è la sua posizione a riguardo?

Scorza: L’esperienza più “alta” è quella di chi ha vissuto questo periodo da cittadino comune senza ruoli potenzialmente capaci di viziare la sua percezione dei fenomeni. In ogni caso, la mia sensazione, è che, in generale, in Italia, con poche eccezioni, si sia stati bravi: abbiamo cercato sempre o quasi una buona posizione di equilibrio tra la difesa del diritto alla privacy del singolo e quello collettivo alla tutela della salute.

Immuni ne è un esempio: abbiamo detto sì al tracciamento senza, tuttavia, compromettere la privacy delle persone. E in genere, in democrazia, dovrebbe essere così perché non esistono diritti tiranni, diritti che fagocitano altri diritti. Non è tiranno il diritto alla privacy e non è tiranno il diritto alla salute.

Ziccardi: Il tracciamento dei dati di cittadini in periodo di pandemia o di contagio non è poi, in linea di principio, né una novità, né un problema. Non è una novità perché già è stato fatto in occasione di altri eventi tragici, e in altri Paesi diversi dal quadro europeo, e ha dimostrato di poter portare benefici.

Non è un problema perché è possibile effettuare attività di tracciamento con modalità che siano compatibili con i diritti delle persone e con la tutela della loro privacy. I problemi, quindi, sono altri due. Il primo è se il sistema di tracciamento può contare su una informatizzazione della società che ne consenta l’efficacia (con, ad esempio, un dialogo efficace con il sistema sanitario). Il secondo è di elaborare un sistema di tracciamento che sia rispettoso delle norme sulla protezione dei dati.

I Garanti europei hanno delineato con cura tutti gli elementi che dovrebbe avere un sistema di tracciamento per essere rispettoso delle norme, e tutti gli sviluppatori di sistemi simili sono tenuti a seguire tali indicazioni (non solo correlate all’anonimato, ad esempio, dei positivi ma anche al periodo di conservazione dei dati, al divieto di diffusione, alla trasparenza).

La privacy e la protezione dei dati non sono un ostacolo a queste attività, come è stato sostenuto, semplicemente perché il ragionamento che deve essere fatto è il contrario: queste attività si possono fare solo se rispettano la privacy e diritti delle persone. E questo equilibrio si può raggiungere.

- La nostra società diventa sempre più automated e tecnologica: quali sono i rischi del trattamento di dati e sicurezza quando entrano in gioco macchine e intelligenze artificiali?

Scorza: Posso chiedere di cambiare domanda? I rischi sono infiniti come d’altra parte le opportunità anche perché per quanto già ci sembri, talvolta, di vivere in un romanzo di fantascienza e per quanto sia ormai diventato difficile scrivere romanze di fantascienza perché si rischia di essere superati dalla realtà prima che il libro esca in libreria è fuori di dubbio che abbiamo ancora visto poco davvero rispetto a quello che ci aspetta solo tra qualche anno.

Ziccardi: I rischi sono tanti. Mi vengono in mente la discriminazione dell’individuo, la sua “catalogazione” (il social scoring, ossia il dare a ogni individuo un punteggio, magari a fine giornata, che condiziona l’accesso ai servizi della società in cui vive), la perdita di controllo dei propri dati. Kafka prevedeva, nei suoi romanzi, un rischio “labirintico” dove il protagonista perde il controllo delle informazioni che lo riguardano tra burocrazia, uffici, errori giudiziari.

Oggi il rischio è che si perda completamente il controllo del tracciamento dei nostri dati e che si sia soggetti a decisioni che ci arrechino danni e che non siano da noi comprensibili o spiegabili.

Scorza: Una delle mie maggiori preoccupazioni della società automatizzata nella quale stiamo vivendo e vivremo è, comunque, rappresentato dal rischio di bias, discriminazioni. Il problema non sono tanto gli algoritmi secondo me – sebbene, naturalmente, anche gli algoritmi siano inesorabilmente intrisi di tutti i pregiudizi diffusi nella società ma i dati che si usano per addestrarli. Dati sbagliati significa oggi e significherà sempre di più domani decisioni sbagliate e dopo che le decisioni automatizzate saranno state assunte, sarà davvero difficile per chiunque di noi convincere chi l’ha assunta attraverso un’intelligenza artificiale che si tratta di una decisione sbagliata.

Sul suo blog, Professor Ziccardi, Lei ha parlato dell’importanza di essere i primi a tutelare i propri dati, partendo ad esempio dall’autenticazione a due fattori.

- Quali consigli darebbe a un utente e consumatore web per essere il più tutelato possibile nell’ambiente digitale?

Ziccardi: Sì, il momento dell’autenticazione, ossia dell’accesso a tutti i nostri dati e sistemi, è ancora molto sottovalutato. L’idea di password ce la portiamo dietro da quasi cento anni e andrebbe dimenticata, prediligendo sistemi che chiedano più verifiche, all’individuo, per permettergli di accedere ai suoi dati.

Aumentare i fattori necessari (usando, ad esempio, OTP, tessere, il telefonino o app specifiche) aumenta di conseguenza la nostra sicurezza. Il mondo bancario è stato il primo, negli anni passati, a obbligare a questa migrazione verso sistemi di autenticazione più forti e i risultati si sono visti, in termini di sicurezza. Consiglierei quindi una autenticazione forte e una costante ridondanza dei nostri dati, con backup fatti in tempo reale e in più luoghi. Ciò ci mette al riparo sia da possibili attacchi, sia da incidenti.

Sempre sul suo blog, Professor Ziccardi, Lei scrive che gran parte della tutela dei dati passa anche da una serie di “corretti” comportamenti umani.

- Può spiegarci meglio che cosa intende a riguardo?

Ziccardi: Si tratta della human security. Molto spesso è più semplice attaccare il cervello delle persone, per entrare nel loro computer o telefono, che il device informatico stesso. Se si costringono le persone a tenere comportamenti sbagliati, si aprono porte di accesso per il sistema.

Si pensi a una persona che clicca su link un fraudolento, che apre un allegato contenente un virus, che raccoglie una chiavetta USB contenente un trojan e la inserisce nel proprio portatile, o un utente che semplicemente fornisce informazioni utili, via mail, per accedere ai suoi sistemi. Sotto pandemia, poi, gli attacchi informatici che colpiscono i comportamenti hanno avuto un aumento sensibile perché le persone sono diventate ancora più tese e vulnerabili.

- Qual è la situazione oggi in merito alla cyber security? Anche a fronte della notizia di questi giorni che Linkedin, piattaforma utilizzata da milioni di utenti in tutto il mondo, è stata vittima di data breach, con i dati di circa 700 milioni di utenti in pericolo (il 92% degli utenti).

Scorza: Quelli più bravi tra i miei amici che si occupano di cyber security non smettono mai di ricordarmi che la sicurezza, quella vera e assoluta, non esiste. Non c’è ancora unanimità di vedute circa la circostanza che Linkedin abbia effettivamente subito un breach ma, tutto sommato, conta poco perché data breach anche importanti sono all’ordine del giorno.

Non amo ripetermi ma, anche in questo caso, non credo che si tratti di una partita tecnologica o, almeno, di una partita che si può vincere semplicemente a colpi di tecnologia. Bisogna educare le persone, le aziende e le amministrazioni al valore dei dati – personali e non – perché nella più parte dei casi le nostre menti sono più vulnerabili dei nostri sistemi informatici.

Ziccardi: È una situazione complessa. La pandemia ha portato poi, in molti ambiti, crisi economica, e i primi tagli sono stati proprio in questo ambito, soprattutto per le piccole e medie aziende. La sicurezza è, infatti, molto costosa. Vi è poi un problema di cyber security in molte strutture pubbliche, che pagano il fatto di non aver previsto, negli anni passati, dei piani ordinati e metodici di azione in tal senso.

Accanto agli investimenti diventa, poi, essenziale la formazione specifica e mirata di tutti coloro che trattano dati. Anche in questo caso, molti piani di formazione non sono mai stati portati a compimento generando una vulnerabilità “congenita” in molte strutture.

- È stata da poco pubblicata la Relazione sull’attività 2020 del Garante della Privacy, con grande focus su tutela dei minori su piattaforme social come Tik Tok, revenge porn e cyberbullismo. Avvocato Scorza, in che modo il Garante supporta i consumatori per tutelarsi riguardo queste possibili minacce online?

Scorza: Ce la stiamo mettendo tutta anche se, confesso, che a volte la sensazione è quella di Sant’Agostino davanti al famoso bambino che pretendeva di svuotare il mare con un secchiello.

Stiamo cercando di educare i ragazzi a evitare di finire vittima di questo genere di fenomeni e, comunque, quando qualcosa va storto – perché purtroppo è inevitabile che possa accadere – a contattare il Garante per chiedere aiuto: troppo stesso questi illeciti che pure generano un enorme patimento nei più piccoli non vengono neppure denunciati.

E poi stiamo lavorando un po’ sulla tecnologia: grazie a un recente accordo con Facebook e Instagram, ad esempio, oggi siamo in grado di bloccare, in via preventiva, la messa online di un video a sfondo sessuale e, quindi, laddove manchi il consenso della persona che vi è ritratta, di un video di revenge porn.

Comments by Gabriele Sebastiani